您现在的位置是: 首页 > 旅游天气 旅游天气

广东天气微博新浪微博_广东天气网微博

zmhk 2024-06-11 人已围观

简介广东天气微博新浪微博_广东天气网微博 我很了解广东天气微博新浪微博这个话题,并且可以为您提供一系列的信息和建议。请告诉我您需要了解什么。1.�㶫������������2.五一广东天气

我很了解广东天气微博新浪微博这个话题,并且可以为您提供一系列的信息和建议。请告诉我您需要了解什么。

1.�㶫������������

2.五一广东天气预报广东室内好玩的地方推荐

3.今年春节是史上最冷春节?

�㶫������������

0x00. 起因

因为参加学校大学生创新竞赛,研究有关微博博文表达的情绪,需要大量微博博文,而网上无论是国内的某度、csdn,还是国外谷歌、gayhub、codeproject等都找不到想要的程序,没办法只能自己写一个程序了。

ps.在爬盟找到类似的程序,但是是windows下的,并且闭源,而且最终爬取保存的文件用notepad++打开有很多奇怪的问题,所以放弃了。

0x01. 基础知识

本程序由Python写成,所以基本的python知识是必须的。另外,如果你有一定的计算机网络基础,在前期准备时会有少走很多弯路。

对于爬虫,需要明确几点:

1. 对爬取对象分类,可以分为以下几种:第一种是不需要登录的,比如博主以前练手时爬的中国天气网,这种网页爬取难度较低,建议爬虫新手爬这类网页;第二种是需要登录的,如豆瓣、新浪微博,这些网页爬取难度较高;第三种独立于前两种,你想要的信息一般是动态刷新的,如AJAX或内嵌资源,这种爬虫难度最大,博主也没研究过,在此不细举(据同学说淘宝的商品评论就属于这类)。

2. 如果同一个数据源有多种形式(比如电脑版、手机版、客户端等),优先选取较为“纯净的”展现。比如新浪微博,有网页版,也有手机版,而且手机版可以用电脑浏览器访问,这时我优先选手机版新浪微博。

3. 爬虫一般是将网页下载到本地,再通过某些方式提取出感兴趣的信息。也就是说,爬取网页只完成了一半,你还要将你感兴趣的信息从下载下来的html文件中提取出来。这时就需要一些xml的知识了,在这个项目中,博主用的是XPath提取信息,另外可以使用XQuery等等其他技术,详情请访问w3cschool。

4. 爬虫应该尽量模仿人类,现在网站反爬机制已经比较发达,从验证码到禁IP,爬虫技术和反爬技术可谓不断博弈。

0x02. 开始

决定了爬虫的目标之后,首先应该访问目标网页,明确目标网页属于上述几种爬虫的哪种,另外,记录为了得到感兴趣的信息你需要进行的步骤,如是否需要登录,如果需要登录,是否需要验证码;你要进行哪些操作才能获得希望得到的信息,是否需要提交某些表单;你希望得到的信息所在页面的url有什么规律等等。

以下博文以博主项目为例,该项目爬取特定新浪微博用户从注册至今的所有微博博文和根据关键词爬取100页微博博文(大约1000条)。

0x03. 收集必要信息

首先访问目标网页,发现需要登录,进入登录页面如下新浪微博手机版登录页面

注意url后半段有很多形如”%xx”的转义字符,本文后面将会讲到。

从这个页面可以看到,登录新浪微博手机版需要填写账号、密码和验证码。

这个验证码是近期(本文创作于2016.3.11)才需要提供的,如果不需要提供验证码的话,将有两种方法进行登录。

第一种是填写账号密码之后执行js模拟点击“登录”按钮,博主之前写过一个Java爬虫就是利用这个方法,但是现在找不到工程了,在此不再赘述。

第二种需要一定HTTP基础,提交包含所需信息的HTTP POST请求。我们需要Wireshark 工具来抓取登录微博时我们发出和接收的数据包。如下图我抓取了在登录时发出和接收的数据包Wireshark抓取结果1

在搜索栏提供搜索条件”/(displayID)?page=(pagenum)” 。这将成为我们爬虫拼接url的依据。

接下来查看网页源码,找到我们希望得到的信息的位置。打开浏览器开发者工具,直接定位某条微博,可以发现它的位置,如下所示。

xpath

观察html代码发现,所有的微博都在<div>标签里,并且这个标签里有两个属性,其中class属性为”c”,和一个唯一的id属性值。得到这个信息有助于将所需信息提取出来。

另外,还有一些需要特别注意的因素

* 微博分为原创微博和转发微博

* 按照发布时间至当前时间的差距,在页面上有”MM分钟前”、”今天HH:MM”、”mm月dd日 HH:MM”、”yyyy-mm-dd HH:MM:SS”等多种显示时间的方式* 手机版新浪微博一个页面大约显示10条微博,所以要注意对总共页数进行记录以上几点都是细节,在爬虫和提取的时候需要仔细考虑。

0x04. 编码

1.爬取用户微博

本项目开发语言是Python 2.7,项目中用了一些第三方库,第三方库可以用pip的方法添加。

既然程序自动登录的想法被验证码挡住了,想要访问特定用户微博页面,只能使用者提供cookies了。

首先用到的是Python的request模块,它提供了带cookies的url请求。

import request

print request.get(url, cookies=cookies).content使用这段代码就可以打印带cookies的url请求页面结果。

首先取得该用户微博页面数,通过检查网页源码,查找到表示页数的元素,通过XPath等技术提取出页数。

页数

项目使用lxml模块对html进行XPath提取。

首先导入lxml模块,在项目里只用到了etree,所以from lxml import etree

然后利用下面的方法返回页数

def getpagenum(self):

url = self.geturl(pagenum=1)

html = requests.get(url, cookies=self.cook).content # Visit the first page to get the page number.

selector = etree.HTML(html)

pagenum = selector.xpath('//input[@name="mp"]/@value')[0]

return int(pagenum)

接下来就是不断地拼接url->访问url->下载网页。

需要注意的是,由于新浪反爬机制的存在,同一cookies访问页面过于“频繁”的话会进入类似于“冷却期”,即返回一个无用页面,通过分析该无用页面发现,这个页面在特定的地方会出现特定的信息,通过XPath技术来检查这个特定地方是否出现了特定信息即可判断该页面是否对我们有用。

def ispageneeded(html):

selector = etree.HTML(html)

try:

title = selector.xpath('//title')[0]

except:

return False

return title.text != '微博广场' and title.text != '微博'

如果出现了无用页面,只需简单地重新访问即可,但是通过后期的实验发现,如果长期处于过频访问,返回的页面将全是无用页面,程序也将陷入死循环。为了避免程序陷入死循环,博主设置了尝试次数阈值trycount,超过这个阈值之后方法自动返回。

下面代码片展示了单线程爬虫的方法。

def startcrawling(self, startpage=1, trycount=20):

attempt = 0

try:

os.mkdir(sys.path[0] + '/Weibo_raw/' + self.wanted)except Exception, e:

print str(e)

isdone = False

while not isdone and attempt < trycount:

try:

pagenum = self.getpagenum()

isdone = True

except Exception, e:

attempt += 1

if attempt == trycount:

return False

i = startpage

while i <= pagenum:

attempt = 0

isneeded = False

html = ''

while not isneeded and attempt < trycount:

html = self.getpage(self.geturl(i))

isneeded = self.ispageneeded(html)

if not isneeded:

attempt += 1

if attempt == trycount:

return False

self.savehtml(sys.path[0] + '/Weibo_raw/' + self.wanted + '/' + str(i) + '.txt', html)print str(i) + '/' + str(pagenum - 1)

i += 1

return True

考虑到程序的时间效率,在写好单线程爬虫之后,博主也写了多线程爬虫版本,基本思想是将微博页数除以线程数,如一个微博用户有100页微博,程序开10个线程,那么每个线程只负责10个页面的爬取,其他基本思想跟单线程类似,只需仔细处理边界值即可,在此不再赘述,感兴趣的同学可以直接看代码。另外,由于多线程的效率比较高,并发量特别大,所以服务器很容易就返回无效页面,此时trycount的设置就显得更重要了。博主在写这篇微博的时候,用一个新的cookies,多线程爬取现场测试了一下爬取北京邮电大学的微博,3976条微博全部爬取成功并提取博文,用时仅15s,实际可能跟cookies的新旧程度和网络环境有关,命令行设置如下,命令行意义在项目网址里有说明python main.py _T_WM=xxx; SUHB=xxx; SUB=xxx; gsid_CTandWM=xxx u bupt m 20 20爬取的工作以上基本介绍结束,接下来就是爬虫的第二部分,解析了。由于项目中提供了多线程爬取方法,而多线程一般是无序的,但微博博文是依靠时间排序的,所以项目采用了一种折衷的办法,将下载完成的页面保存在本地文件系统,每个页面以其页号为文件名,待爬取的工作结束后,再遍历文件夹内所有文件并解析。

通过前面的观察,我们已经了解到微博博文存在的标签有什么特点了,利用XPath技术,将这个页面里所有有这个特点的标签全部提取出来已经不是难事了。

在这再次提醒,微博分为转发微博和原创微博、时间表示方式。另外,由于我们的研究课题仅对微博文本感兴趣,所以配图不考虑。

def startparsing(self, parsingtime=datetime.datetime.now()):

basepath = sys.path[0] + '/Weibo_raw/' + self.uidfor filename in os.listdir(basepath):

if filename.startswith('.'):

continue

path = basepath + '/' + filename

f = open(path, 'r')

html = f.read()

selector = etree.HTML(html)

weiboitems = selector.xpath('//div[@class="c"][@id]')for item in weiboitems:

weibo = Weibo()

weibo.id = item.xpath('./@id')[0]

cmt = item.xpath('./div/span[@class="cmt"]')if len(cmt) != 0:

weibo.isrepost = True

weibo.content = cmt[0].text

else:

weibo.isrepost = False

ctt = item.xpath('./div/span[@class="ctt"]')[0]

if ctt.text is not None:

weibo.content += ctt.text

for a in ctt.xpath('./a'):

if a.text is not None:

weibo.content += a.text

if a.tail is not None:

weibo.content += a.tail

if len(cmt) != 0:

reason = cmt[1].text.split(u'\xa0')

if len(reason) != 1:

weibo.repostreason = reason[0]

ct = item.xpath('./div/span[@class="ct"]')[0]

time = ct.text.split(u'\xa0')[0]

weibo.time = self.gettime(self, time, parsingtime)self.weibos.append(weibo.__dict__)

f.close()

方法传递的参数parsingtime的设置初衷是,开发前期爬取和解析可能不是同时进行的(并不是严格的“同时”),微博时间显示是基于访问时间的,比如爬取时间是10:00,这时爬取到一条微博显示是5分钟前发布的,但如果解析时间是10:30,那么解析时间将错误,所以应该讲解析时间设置为10:00。到后期爬虫基本开发完毕,爬取工作和解析工作开始时间差距降低,时间差将是爬取过程时长,基本可以忽略。

解析结果保存在一个列表里,最后将这个列表以json格式保存到文件系统里,删除过渡文件夹,完成。

def save(self):

f = open(sys.path[0] + '/Weibo_parsed/' + self.uid + '.txt', 'w')jsonstr = json.dumps(self.weibos, indent=4, ensure_ascii=False)f.write(jsonstr)

f.close()

2.爬取关键词

同样的,收集必要的信息。在微博手机版搜索页面敲入”python”,观察url,研究其规律。虽然第一页并无规律,但是第二页我们发现了规律,而且这个规律可以返回应用于第一页第一页

第二页

应用后第一页

观察url可以发现,对于关键词的搜索,url中的变量只有keyword和page(事实上,hideSearchFrame对我们的搜索结果和爬虫都没有影响),所以在代码中我们就可以对这两个变量进行控制。

另外,如果关键词是中文,那么url就需要对中文字符进行转换,如我们在搜索框敲入”开心”并搜索,发现url如下显示搜索开心

但复制出来却为

/search/mblog?hideSearchFrame=&keyword=%E5%BC%80%E5%BF%83&page=1幸好,python的urllib库有qoute方法处理中文转换的功能(如果是英文则不做转换),所以在拼接url前使用这个方法处理一下参数。

另外,考虑到关键词搜索属于数据收集阶段使用的方法,所以在此只提供单线程下载网页,如有多线程需要,大家可以按照多线程爬取用户微博的方法自己改写。最后,对下载下来的网页进行提取并保存(我知道这样的模块设计有点奇怪,打算重(xin)构(qing)时(hao)时再改,就先这样吧)。

def keywordcrawling(self, keyword):

realkeyword = urllib.quote(keyword) # Handle the keyword in Chinese.

try:

os.mkdir(sys.path[0] + '/keywords')

except Exception, e:

print str(e)

weibos = []

try:

highpoints = re.compile(u'[\U00010000-\U0010ffff]') # Handle emoji, but it seems doesn't work.

except re.error:

highpoints = re.compile(u'[\uD800-\uDBFF][\uDC00-\uDFFF]')pagenum = 0

isneeded = False

while not isneeded:

html = self.getpage('/search/mblog?keyword=%s&page=1' % realkeyword)isneeded = self.ispageneeded(html)

if isneeded:

selector = etree.HTML(html)

try:

pagenum = int(selector.xpath('//input[@name="mp"]/@value')[0])except:

pagenum = 1

for i in range(1, pagenum + 1):

try:

isneeded = False

while not isneeded:

html = self.getpage('/search/mblog?keyword=%s&page=%s' % (realkeyword, str(i)))isneeded = self.ispageneeded(html)

selector = etree.HTML(html)

weiboitems = selector.xpath('//div[@class="c"][@id]')for item in weiboitems:

cmt = item.xpath('./div/span[@class="cmt"]')if (len(cmt)) == 0:

ctt = item.xpath('./div/span[@class="ctt"]')[0]

if ctt.text is not None:

text = etree.tostring(ctt, method='text', encoding="unicode")tail = ctt.tail

if text.endswith(tail):

index = -len(tail)

text = text[1:index]

text = highpoints.sub(u'\u25FD', text) # Emoji handling, seems doesn't work.

weibotext = text

weibos.append(weibotext)

print str(i) + '/' + str(pagenum)

except Exception, e:

print str(e)

f = open(sys.path[0] + '/keywords/' + keyword + '.txt', 'w')try:

f.write(json.dumps(weibos,indent=4,ensure_ascii=False))except Exception,ex:

print str(ex)

finally:

f.close()

博主之前从未写过任何爬虫程序,为了获取新浪微博博文,博主先后写了3个不同的爬虫程序,有Python,有Java,爬虫不能用了是很正常的,不要气馁,爬虫程序和反爬机制一直都在不断博弈中,道高一尺魔高一丈。

另. 转载请告知博主,如果觉得博主帅的话就可以不用告知了

五一广东天气预报广东室内好玩的地方推荐

方法1:最快速的方法/最不推荐的方法

1、花钱买僵尸粉,满足自己的虚荣心。此种方法简单粗暴涨粉效果好,但是很丢人。获得的分析都行营销公司电脑自动注册的垃圾账号,对用户本人无任何实质性的意义,只建议那些想做网络红人的用户且不怕烧钱的采用此种方法。

2、直接在淘宝等购物网站搜索僵尸粉即可

方法2:初期可采用的方法

1、进入互粉大厅/互粉社区,疯狂求互粉。但是受到新浪系统设置的限制,这种求粉信息发送比较麻烦且受到上限制约,效果并不是很好。但我又好方法,可以解决这个问题。

2、将自己的头像选择成一位自然自拍的美女(注意不要那种一看就是假的网路),自己的资料也要改成女性,最好是年龄比较小的,标签比较萌的。然后再互粉大厅里发博说:“微博怎么玩啊?”、“新浪微博怎么这么复杂?”、“妹子我就这么没有魅力吗?粉丝这么少”.....总之怎么恶心怎么来,怎么幼稚就怎么发,会有些痴汉是无辨别能力的。

记住一定要在每个微博后面都加上“自己”的自拍照

3、坚持一个星期,你的粉丝必过1K人

方法3:稳健的快速涨粉方法,本人一直使用

1、微博是一个信息资源大量集中的地方,网友们的精力和好奇心都是有限的,他们只会关注那些大家都在关注的话题。于是热门话题就出现,每天新浪都会精选数十条热度最高的话题放在热门微博TOP榜上。这些微博是你涨粉的最佳阵地,坚守住你就能成为粉丝过万的小V

2、每天都在TOP10的热门微博下面进行评论,语气已经要稚嫩,要充满正能量。博主被攻击时你一定要无条件大量废话的去支持博主,这样博主NC粉们就会视你为战友主动加你。对于设计政治、民生的话题尽量不要去过于评论,因为很可能你的评论会被其中一方攻击、举报,不利于你账号的信用。

方法4:解决根本问题,涨粉自然不需操心

1、每一个微博不管是个人的还是组织的,都要有自己的一个定位。比如“人民日报”它就是借助微博来推广自己报纸的,你让它整体博天气,那这个微博的就废了,因为定位错误功能就体现不来。

既然我们掌握这个原则,那么我们如何定位自己的微博呢?

2、首先是自己比较喜欢关注的领域,其次看要整个网民群体喜欢关注什么领域。美女、帅哥、美食、萌宠、**、歌曲、时装、保养、健身、情感等这些都网友比较热衷的领域。

每天都发一些萌宠的照片,配上细腻的文字,你不涨粉都难。选定一个定位后千万不要乱换,你今天发美食明天换歌曲后天又发旅游,你的粉丝不会有你这么多的关注点,很快就会被你搞晕从而取消对你的关注,当然你要是明星那就无所谓了。

定位准确把握网友喜欢领域,内容充实丰富拴住粉丝热情,才是微博涨粉之王道。

3、此种方法是建立在拥有一定的活跃粉丝基础上的,如果你不能保证每天都有10位以上粉丝评论的话,那就注册小号猥琐换马甲评论吧。时间久了就OK了。

今年春节是史上最冷春节?

相信大家即使是没有去广东这里,也在微博等社交平台上了解了最近广东这里的多变天气了吧!那么,我们五一来广东这里天气怎么样呢?如果来这里下雨了我们怎么办呢?今天小编就来给大家简单的说一下广东的五一天气情况和室内好玩的地方吧!

五一广东天气预报

根据天气预报的显示,在未来三天广东的天气可以说是一直和雨离不开了,其中在二十八号,这里的粤西、珠江三角洲西部、韶关、清远市有中雨到大雨局部暴雨,其余市县多云有(雷阵雨;二十九号韶关、清远市多云转中雨到大雨局部暴雨,粤东多云间晴有分散阵雨,其余市县多云有(雷阵雨。

在三十号之后,广东这里即将迎来一次局部的大暴雨和强对流的天气,且降雨的范围比较广!所以说在五一期间,广东的天气还是不稳定的,所以大家一定要在出门前看看天气预报啊!

广东室内好玩的地方推荐速马赫卡丁车

参考价格:85元/人/7分钟

地点:新港东路广州国际采购中心5楼

相信卡丁车,大家是知道的,小编就很喜欢玩,在广东的这里,有着一个八十五元钱玩七分钟的真人卡丁车啊!虽然时间不长,但是很是刺激和好玩!就感觉自己是一个赛车手一样!

长藤鬼校(广州旗舰店

人均:77元

地址:文明路精彩生活大厦3楼

说起鬼屋,每次去游乐园都是又害怕又想进去的,但是大家要是想在广东这里来一次鬼屋之旅的话,小编建议大家来这里的长藤鬼校啊!

这里可以说是真的很逼真的!不管是这里的道具设计还是这里的鬼叫都可以让你十分的害怕啊!就像是真实的一样!

还有就是如果你害怕的话,可以买一个驱魔令,这样这里的鬼就不会扯你衣服了!

阿里体育嗨马乐动室内运动嘉年华(南丰汇店

参考价格:89/人/小时

地址:广州市海珠区新港东路618号,南丰汇一层地铁8号线F口

如果大家喜欢户外运动,那么就来这里,这里虽然是室内,但是这里却有着很多的户外类型的运动项目,比如说这里的攀岩,蹦击球,空中灌篮等等,保证让你一次玩个够!

梦弓场射箭俱乐部

参考价格:36元

地址:革新路环岛路大阪仓B01(太古仓**院向北四百米

溜真冰

参考价格:75元/2小时,周末加10块

地址:体育东路正佳广场5楼中庭

好了,这些就是关于广东的天气和室内好玩的地方的推荐,希望可以帮助到大家,祝大家玩的愉快啊!

今年春节是史上最冷春节?气象部门称系

谣传不得不说,2017年的“冬天”热得有些不像话。1月5日,微信朋友圈流传一份1月23日到2月17日的天气预报,声称今年将是史上最冷的春节,提醒公众要注意防寒保暖。气象专家称不是出自气象部门,是谣传。今年到底会不会出现冷冬呢

信息时报讯(记者 黄熙灯)前日起,一份宣称“史上最冷春节”的天气预报在网上流传。该预报称,大年初四广东会出现零下2℃低温。对此,昨日广东省气象台官方微博“@广东天气”直指其为谣言。据了解,尽管现在离春节还有一段时间,预报时效比较长,但现有的结论都倾向于:春节期间广东天气较为温暖。

气象部门给这份预报“差评”

这份网传的天气预报标题为“史上最冷的春节,2017广东省天气预报”,内文显示1月23日到2月17日期间的天气预告信息,其中,最冷的时候只有-2℃,最高温为15℃。

“这是谣言!不可信!”“@广东天气”对该谣言进行了剖析。首先,对“2017广东省天气预报”进行了质疑:“我大广东东西跨度约800公里,南北跨度约600公里,很大的哦,请问你说的是清远还是湛江啊?两者差别很大的哦!”

接着,“@广东天气”提问:“你这个预报是谁发布的啊?哪个气象台啊?还是自制的啊?”继续追问:“你这个预报是什么时候发布的啊?不同时次发布的天气预报结论会有所不同,因此,媒体传播气象预报必须注明发布时间哦亲。”最后,“@广东天气”给该“预报”下了结论:“差评!差评!差评!”

去年1月也传过这类谣言

记者上网搜索发现,“史上最冷春节”的消息并不少见,比如,去年1月份就出现过。今年流传的谣言几乎是去年的翻版,像去年预报说大年初四的最低气温只有-2℃,今年也是这样说。记者还发现,不同的省份流传的谣言内容都是一样的,如“史上最冷的春节,2017海南省天气预报”“史上最冷的春节,2017广西天气预报”。

“@广东天气”提醒,气象部门非常鼓励媒体和单位传播气象预报,但媒体和单位传播气象预报应当使用当地气象主管机构所属的气象台提供的最新气象预报,并注明气象预报发布的气象台名称和发布时间,不得自行更改气象预报的内容和结论。

今年1月全省平均气温高于往年

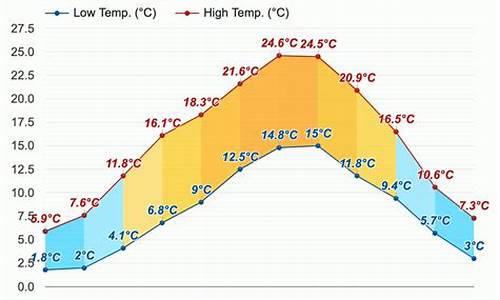

那么,今年春节广东的天气趋势是怎样的?“@广东天气”给出了预测:1月全省平均气温13.9℃,较常年同期偏高0.5℃左右;预计1月内主要冷空气过程有3次,大致出现在8日~13日(中等偏强)、16日~20日(偏弱)、27日~29日(偏弱);1月广东省主要降水过程有2次,大致出现在11日~13日(中到大雨)、27日~29日(小雨);1月广东省出现寒潮天气的可能性较小。

至于广州,在1月平均气温方面,广州市各区比常年同期偏高0~1.0℃,即13℃~15℃;最低气温方面,与常年同期接近,即4℃左右;月内主要降水过程有2次,大致出现在11日~13日(中雨)、27日~29日(小雨)。

对于广州除夕和春节的天气情况,昨日,中国天气网给出的预测是:气温11℃~23℃,除了除夕和初一有小雨外,其他时段天气为多云。

不过,气象部门提醒,距离春节还有一段时间,预测时间较长,具有一定的不确定性,所以,请大家持续关注当地气象部门滚动更新的天气预报。

好了,关于“广东天气微博新浪微博”的话题就到这里了。希望大家通过我的介绍对“广东天气微博新浪微博”有更全面、深入的认识,并且能够在今后的实践中更好地运用所学知识。

上一篇:广东气象预警_广东气象预警网